- Программа 2025 года: лучшие практики, инструменты и технологии

- Ключевые NLP‑архитектуры: от вариаций BERT до RAG и агентных систем

- Фокус на актуальные задачи: NER, QA, VQA, машинный перевод и сценарии с RAG

- Пошаговое погружение в передовые LLM

- 4 проекта в портфолио и практика на реальных бизнес‑задачах

- Удостоверение о повышении квалификации

Natural Language Processing позволяет нейросетям понимать человека

В том числе имитировать разговор, выполнять запросы, извлекать пользу из массивов естественной речи

Например, NLP используют чат‑боты, голосовые ассистенты, автопереводчики, сложные аналитические системы

Курс подойдёт тем, у кого есть опыт работы с данными, Machine Learning и Deep Learning

Специалистам в области Data Science

Разберёте методы извлечения признаков из текста и сможете применять NLP для работы с большими данными и решения бизнес-задач

DL- и ML‑инженерам

Изучите способы обработки текстовых данных и современные архитектуры и будете использовать NLP в своих реальных проектах

Разработчикам

Освоите актуальные библиотеки и инструменты, чтобы внедрить технологии NLP в разработку приложений, которые используют текстовые данные

Если у вас нет базы в DL, посмотрите курс «Инженер по глубокому обучению нейросетей»

Сначала научитесь работать на фреймоворке PyTorch, строить, обучать нейросети и подготавливать данные, а потом сможете выбрать специализацию — в том числе NLP

Посмотреть курс

Посмотреть курс

Чему научитесь за 2 месяца

- Понимать и применять современные NLP‑модели: от BERT до LLM

- Строить RAG и агентные системы

- Обучать LLM с оптимизацией операций на GPU

- Создавать модели генерации текста, перевода, NER и мультимодальные решения

- Работать с поиском: от классического BM25 до векторного по эмбеддингам

Освоите продвинутые подходы, модели и архитектуры

GPT

RoBERTa

DeBERTa

NER

AutoGen

STF

PEFT

RLHF

LoRA

vLLM

TS

Seq2Seq

RAG

ANN

FAISS

BM25

CLIP

SigLip

Векторные БД

Florence

LangChain

AutoGen

smolagents

MCP

ElasticSearch

Программу обновляем регулярно, чтобы вы проходили только актульное

Курс идёт 2 месяца; нагрузка — от 15 часов в неделю

2 часа

Бесплатно

Нейросетевые решения на практике

1

1 проект・2 недели

Современные модели: обучение и ключевые механизмы

2

1 проект・2 недели

Большие языковые модели

3

1 проект・2 недели

Путь генеративного NLP: от Seq2Seq к RAG

4

1 проект・2 недели

Современный NLP: поиск, агенты и мультимодальность

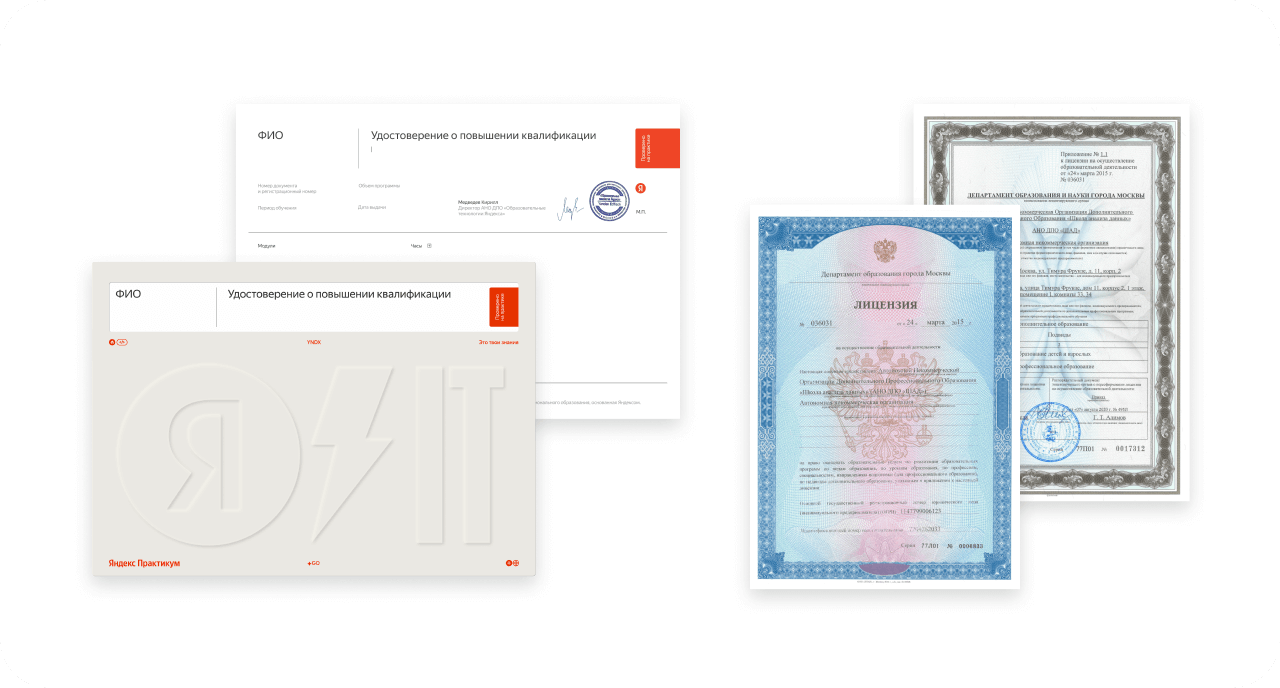

Получите удостоверение о повышении квалификации

Это официальный документ установленного образца, который принимают работодатели. Образовательная лицензия № Л035‑01298‑77/00185314 от 24 марта 2015 года.

Как устроен курс

Наглядная теория на интерактивной платформе

Материалы подготовлены на основе реальных задач, с которыми работают инженеры по обучению нейросетей. Можно заниматься в своём темпе и совмещать с работой.

Очень много практики

За курс сделаете 4 проекта — закрепите новые навыки и пополните портфолио. Работы важно сдавать в срок, чтобы получить подробную обратную связь от опытных инженеров.

Воркшопы с экспертами по расписанию

На них опытные наставники разберут кейсы из различных индустрий и продемонстрируют, как технологии и навыки из курса можно применять для ваших проектов.

Практикум AI помогает учиться

Когда в теории что-то непонятно, нейросеть объяснит это другими словами. А в конце каждого урока подготовит краткий пересказ о самом главном.

2 формата обучения на выбор

- С дедлайнами. Модули открываются по расписанию — их важно проходить за определённое время. Проекты тоже нужно сдавать точно в срок.

- В своём темпе. Темы и задания открываются по мере прохождения. Можно завершить курс быстрее или продлить обучение на месяц.

Подробнее об обучении в своём темпе

Будете заниматься сами, но не в одиночестве — вас поддержат эксперты и команда Практикума

Авторы — инженеры с большим опытом обучения нейросетей

Они собрали и систематизировали свои знания, чтобы вы учились на реальных кейсах, с которыми сталкиваются специалисты на практике

Антон Моргунов

Программный эксперт курса. Senior ML‑инженер в Базис Центре.

Даниил Вяжев

Исследователь в Научно-учебной лаборатории моделей и методов вычислительной прагматики в ВШЭ. Мидл DL/ML-инженер в НБКИ. PhD Student в Сколтехе.

Кирилл Бобылев

Senior Data Sсientiest в Ozon Tech. Специализируется в Moderation, Anti‑fraud, QC.

Станислав Жбанников

NLP‑инженер в GigaChat Pretrain. Занимается оптимизацией обучения крупных MoE‑моделей. Был Lead Data Scientist в Ecom.tech, руководил DS‑командой разработки умного ассистента для поиска товаров.

Ещё у нас есть курс по компьютерному зрению

Освоите детекцию объектов, генерацию изображений и работу с видеопотоком — и сможете создавать модели для анализа и интерпретации визуальной информации

Посмотреть курс

Посмотреть курс

Этот курс может оплатить

ваш работодатель

ваш работодатель

Полностью или разделив оплату с вами,

например 50/50 или 75/25

например 50/50 или 75/25

- Расскажем всё про курс

- Сообщим стоимость

- Ответим на ваши вопросы

- Подготовим договор и счёт

Купить курс — дело серьёзное, поэтому помогаем сэкономить

Оплата курса целиком с выгодой до 20%

Когда решитесь на покупку, увидите итоговую стоимость — она зависит от способа оплаты: целиком или по частям.

Возврат денег

Если передумаете в первую неделю, нужно будет оплатить только время с начала вашего потока. Если позже — время с начала потока и организацию обучения. Подробнее — в 7 пункте оферты.

Посмотреть оферту

Посмотреть оферту

Налоговый вычет

Можно вернуть 13% от стоимости курса — поможем оформить нужные документы.

Если у вас есть вопросы про учёбу, оставьте заявку — мы позвоним

Мы перезваниваем в течение 30 минут каждый день с 10:00 до 19:00. Если оставите заявку сейчас, то перезвоним уже в рабочее время

Отвечаем на вопросы

Каким требованиям нужно соответствовать?

Кто будет меня учить?

Что делать, если я не справлюсь с нагрузкой?

Обучение в своём темпе — это как?

Если не понравится, я могу вернуть деньги?

Получу ли я какой-то документ после курса?

Вы поможете сменить или найти работу?

Как можно оплатить?

Что такое налоговый вычет на обучение и как его получить?

Давайте поможем

Мы перезваниваем в течение 30 минут каждый день с 10:00 до 19:00. Если оставите заявку сейчас, то перезвоним уже в рабочее время.